В эру цифровизации и развития технологий искусственного интеллекта (ИИ) возникает масса философско-этических вопросов о будущей роли человека и робота в складывающемся социально-экономическом укладе. Насколько реальна угроза диктатуры искусственного интеллекта? Почему уже сегодня нужно заниматься вопросами этики ИИ? Существуют ли прорывные решения в области ИИ-технологий? Об этих и других вопросах мы побеседовали с вице-президентом в области искусственного интеллекта и математического моделирования Сколтеха Максимом Федоровым.

1-3 июля в Сколтехе под председательством Максима Федорова пройдет первая онлайн-конференция, посвящённая проблемам устойчивости, прозрачности и надёжности искусственного интеллекта Trustworthy AI.

Максим, на Ваш взгляд, стоит ли уже сегодня человечеству озаботиться разработкой новой философской модели для существования в цифровом мире, развитие которого неразрывно связано с технологиями искусственного интеллекта (ИИ)?

Качественное отличие технологий сегодняшнего дня от тех, что существовали в прошлом, заключается в том, что они перед обществом поставили некое «зеркало», глядя в которое, мы должны ответить на ряд философских вопросов. Во времена индустриализации и автоматизации производства человек был производительной силой. Сегодня же люди как потребители технологий перестают быть нужны. Например, на передовых японских предприятиях по сборке автомобилей людей в цехах практически нет, а всю работу выполняют роботы. Процесс производства выглядит примерно так: в цех заезжает роботизированный поезд без машиниста с запчастями, а выезжает уже готовый автомобиль. Такой процесс называют дискретным производством — сборка конечных наборов элементов в определённой последовательности, что роботы сейчас делают очень эффективно. Получается, что человек постепенно выходит из традиционного экономического уклада, ведь для работы большинства автоматизированных производств достаточно небольшого количества специалистов. Соответственно, возникает вопрос: а зачем нам вообще люди в производстве? Если раньше можно было оправдать своё существование тем, что нужно зарабатывать или потреблять, а также давать зарабатывать другим, то сейчас этого не нужно. В эру цифровизации, когда технологии получили глобальное влияние, перед каждым человеком встают философские вопросы о его значимости и роли в современном мире, решать которые нужно уже сейчас, а не через 10 лет, когда будет уже поздно.

На последнем Всемирном экономическом форуме в Давосе много говорилось об угрозе цифровой диктатуры искусственного интеллекта. Насколько реальна такая угроза в обозримой перспективе?

Проблема здесь не в каком-то зле, которое якобы исходит от искусственного интеллекта. Технологии сами по себе этически нейтральны. А во зло их использовать или во благо — решает только человек.

Говоря о диктатуре ИИ общество пытается подменить понятия. В реальности у технологий нет субъектности, нет «Я». Искусственный интеллект — это, по сути, упорядоченные куски кода и железа. Цифровые технологии — это лишь инструмент. И никакой мистики здесь тоже нет.

Моя позиция как специалиста заключается в том, что сейчас ИИ — это часть информационно-коммуникационных технологий (ИКТ). Нет даже отдельно выделенного компьютера, где «живет» ИИ. Для человека из технической области искусственный интеллект — это целый стек (англ. stack — стопка) технологий, который условно называется слабым ИИ.

Мы надуваем мыльный пузырь важности ИИ и напрасно придаем этому набору технологий свойства субъекта. Во многом это делается журналистами, людьми без технического образования. Они обсуждают какую-то сущность, которой не существует. В массовом сознании формируется мем про ИИ, который наделяется чертами терминатора с одной стороны, и чертами сверхсущества с благими намерениями — с другой. Все это сказки. В реальности у нас существует набор технических решений для построений эффективных систем анализа больших данных, позволяющих быстро принимать решения на основе собираемой информации.

На высоком уровне в различных комитетах обсуждаются проблемы сильного ИИ, а его нет и не будет ближайшие 50–100 лет (а может и вообще не будет). Проблема в том, что, обсуждая опасности, которых нет и не будет в ближайшем будущем, мы пропускаем реальные угрозы. Важно понимать, что такое ИИ и вырабатывать четкий свод этических норм и правил. Если ему следуешь, то получаешь благо, если не следуешь — вред.

Вообще нагнетание опасности от различных угроз — это тренд современного общества. Мы берём проблему, которая влияет на сознание людей, и начинаем ее «раздувать». Мы сейчас рушим экономику по всему миру под предлогом борьбы с коронавирусом, забывая о том, что экономика напрямую влияет на продолжительность жизни, и тем самым «крадем» годы жизни у многих людей. Принятие решений на основе эмоций приводит к опасным перегибам.

По словам философа Явала Харари, сегодня миллионы людей доверяют алгоритмам Google, Netflix, Amazon и Alibaba, которые диктуют нам, что читать, смотреть, покупать, люди теряют контроль над собственными жизнями, и это пугает.

Да, существует опасность «роботизации сознания» человека, вместе с которой падает и его креативность. Сегодня много поступков совершается под влиянием алгоритмов. Например, используя навигатор, водители едут туда, куда им указывает программа, а не следуют собственному пониманию, даже если это не всегда оптимально. Пришло сообщение — надо ответить. Мы стали более заалгоритмизированны. Но не сам алгоритм диктует нам правила и желания, а его создатель.

До сих пор нет документа, регулирующего поведение в киберпространстве на глобальном уровне. Может быть вначале человечеству стоит договориться об универсальных правилах и нормах в киберпространстве, а потом уже заниматься вопросами этики в сфере ИИ?

Я бы сказал, проблема этических норм — первична. Выработав эти номы, мы можем транслировать их на поведение в киберпространстве. Так как сейчас идёт повсеместное проникновение информационных технологий благодаря Интернету (и ИИ не исключение), возникла потребность глобального документа, регулирующего этику технологий ИИ.

Но ведь технологии ИИ — составная часть информационно-коммуникационных технологий (ИКТ). Может быть, не стоит создавать отдельный трек по этике ИИ, а объединить его с треком по международной информационной безопасности (МИБ)? Тем более, что проблемами МИБ плотно занимаются на площадке ООН, где Россия — активный игрок.

Выделение в отдельный трек этики ИИ может быть обосновано, поскольку информационная безопасность и ИИ — это пересекающиеся понятия, но не вложенные одно в другое. Соглашусь, однако, что можно выделить отдельный трек, связанный с информационными технологиями, и его уже разбить на подтреки, где ИИ стоял бы рядом с другими технологиями. В целом это по большей части онтологическая проблема, и как в большинстве такого рода задач, поиск оптимального решения может быть не тривиален.

Вы состоите в международной группе экспертов ЮНЕСКО, которая занимается подготовкой первых глобальных рекомендаций по этике искусственного интеллекта. Существуют ли расхождения в понимании этики ИИ на международном уровне?

В группе идут острые дискуссии, и продвигаемые суждения зачастую противоположны. Например, обсуждается вопрос субъектности и объектности ИИ. В ходе дискуссий четко выделилась группа государств, которая продвигает идею субъектности и пытается ввести такое понятие, как «квазисубъект общества». Иными словами, идут попытки наделить роботов правами. Это опасная тенденция, которая может привести к своего рода технофашизму, затмевающему в своей бесчеловечности все чудовищное в истории нашей цивилизации.

Возможно, продавливание идеи субъектности роботов — это попытка заинтересованных лиц снять с себя ответственность?

Абсолютно верно: возникает ряд проблем. Во-первых, очевидна асимметрия ответственности. Давайте наделим компьютер правами, и если его ошибки приведут к ущербу, то мы его накажем — выключим из розетки или диск отформатируем. То есть вопрос не к создателю техники, а к компьютеру. Создатель получает прибыль, а ущерб расхлебывает тот, кому он нанесён. Во-вторых, как только мы наделим правами ИИ, щепетильные вопросы меньшинств нам покажутся детским садом. За этим сразу последует мысль, что обижать ИИ нельзя, а надо воспитывать (это не шутка, подобные заявления уже делаются на конференциях высокого уровня по этому вопросу). Появится своеобразная «ювенальная юстиция» для ИИ, только она будет на порядок страшнее. Роботы будут защищать права роботов. К примеру, может прилететь дрон и испепелить вашу квартиру, защищая права другого дрона. Это будет технорасизм, но подчиняющийся воле отдельной группы людей. Таким образом, человечество загонит себя в проигрышное положение без понимания как из него выходить.

К счастью, нам удалось убрать из повестки рабочей группы любые вставки касающиеся «квазичлена общества».

Мы очень вовремя создали Комитет по вопросам этики искусственного интеллекта при Комиссии РФ по делам ЮНЕСКО, что помогло определить основные направления нашей работы в рамках рабочей группы. И рады, что не все страны поддерживают субъектность ИИ, а большинство выступают против этой идеи.

Какие еще острые вопросы вы выносили на обсуждение в рамках рабочей группы?

Обсуждался пункт о размытых границах между ИИ и людьми. На мой взгляд, граница должна быть четкой. Далее в дискуссии появилась тема отношений («relationships») между ИИ и человеком, которые подразумевают весь спектр отношений между людьми. Мы предложили «relationships» заменить на «interactions» (взаимодействие), что встретило поначалу от некоторых зарубежных коллег протест, но потом все-таки удалось его уладить.

Учитывая, какими продвинутыми сейчас стали куклы в секс-индустрии, следующим шагом в ряде стран могут быть браки с ними, а потом недалеко и до запроса на венчания в церкви. Если это все не запретить на ранней стадии, то распространение подобных идей примет необратимый характер. За подобным подходом кроются большие деньги, интересы ряда корпораций, другая система ценностей и культура. Среди проводников таких идей — ряд азиатских стран, где активно развито одушевление неживого. Например, в Японии развита традиция почитания духов горы, дерева, дома. С одной стороны, этим воспитывается уважительное отношение к окружающей среде, и я согласен с утверждением, что человек — это часть планеты, часть природы, с которой он должен жить в гармонии. Но все же человек — это человек, дерево — это дерево, и права у них разные.

Есть ли особенность у российского подхода в вопросах этики ИИ?

Мы были единственной стороной, которая четко заявляла, что в принятии решений по вопросам этики ИИ нужен научный подход. К сожалению, большинство представителей из других стран апеллирует не к исследованию проблемы, а к собственному (зачастую субъективному) мнению. Поэтому обсуждения часто скатываются на бытовой уровень, несмотря на то что в группе работают высококвалифицированные люди.

Я полагаю, что должно быть проведено глубокое исследование этих вопросов. Принятие решений такого уровня должно основываться на строгой логике, эксперименте, модели. У нас имеются колоссальные вычислительные мощности, большое количество программных продуктов, которые позволяют моделировать сценарии, и нам ничего не стоит смоделировать миллионы сценариев событий. И только после этого стоит делать какие-либо выводы и принимать решения.

Насколько реально противостоять идеям субъективизации ИИ, если за всем этим стоят огромные деньги? У России есть единомышленники?

Каждый отвечает за свой участок. Наша задача сейчас — планомерно участвовать в дискуссиях. Единомышленники у России есть по разным аспектам проблемы. И, все же, здравый смысл побеждает. Тот эгоцентризм в ряде государств, который сейчас проповедуется, а именно — замкнутость человека на самого себя, в данном случае играет нам на руку. Большинство государств пугает, что человек может перестать быть пупом земли, и им станет робот или компьютер. Поэтому пока что побеждает человекоцентристский подход.

Если экспертной группе удастся выработать рекомендации, то стоит ли ожидать в ближайшем будущем создания некоего международного нормативного акта в области ИИ?

Если говорить о технических стандартах, то они уже сейчас активно разрабатываются на площадке International Standart Organization, где мы участвуем в рамках технического комитета ТК-164 по ИИ. Сейчас нами взят в разработку целый ряд стандартов касающихся различных аспектов ИИ. В плане технического регулирования — это ISO и целый набор документов. Также стоит упомянуть документ IEEE (Институт инженеров электротехники и электроники) — Ethically Aligned Design. На мой взгляд, документ IEEE — это первое полноценное техническое руководство по этическим аспектам технологий автономных и интеллектуальных систем, к числу которых принадлежит и ИИ. Технические стандарты находятся в разработке.

Если говорить о площадке ООН, то, например, в прошлом году был принят Пекинский консенсус по ИИ и образованию. Думаю, что со следующего года уже начнётся разработка нормативов.

То есть на основе рекомендаций будут создаваться нормативные акты?

Да, именно так. Это правильный подход. Отмечу, что важным является участие на ранней стадии. В дальнейшем, например, можно апеллировать к договоренностям в Пекине. Важно не допустить субъектности ИИ в документе ЮНЕСКО, чтобы потом на него не ссылались.

Перейдем от вопросов этики к технологическим достижениям. Какие последние разработки в этой области носят прорывной характер?

Качественных прорывов на текущий момент нет. Распознавание образов, ориентация, навигация, транспорт, совершенствование сенсоров («органов чувств» у роботов) — таковы успехи. Для качественного скачка нужен иной подход.

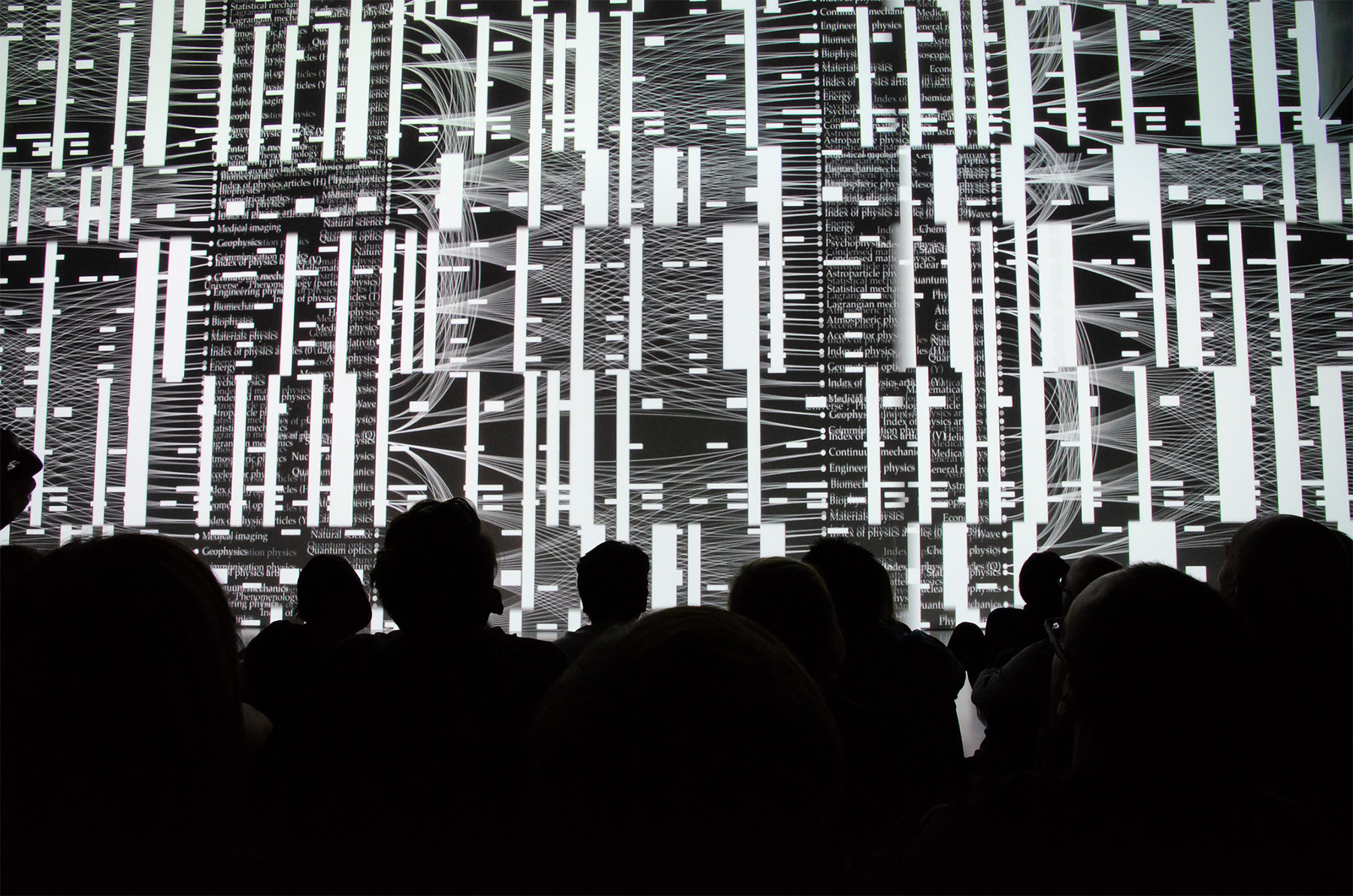

Возьмем, к примеру, «химическую вселенную». Количество исследованных синтезированных соединений на планете — порядка 100 млн. Из них хорошо исследованы, может быть, десятки тысяч. А всего можно синтезировать 1060 различных соединений. Это число превышает количество атомов во Вселенной. Возможно, в этой «химической вселенной» есть лекарства от всех болезней или какие-то принципиально новые сверхпрочные или сверхлегкие материалы. Очень много веществ находятся в организмах, населяющих нашу планету (например, морские ежи), которые, теоретически, могли бы вылечить от многих болезней, поднять людям иммунитет. Однако, синтезировать многие из них пока не получается. Мы не можем собрать всех морских ежей из океана, высушить их и получить из их экстракта таблетку. Однако как раз здесь технологии больших данных и моделирование могут помочь совершить прорыв. Искусственный интеллект может выступить в качестве навигации в «химической вселенной». Любой разумный прорыв в этом направлении принесет нам экспоненциальное умножение доходов. Наш мир могут изменить лекарства без побочных эффектов от СПИДа или рака, либо новые материалы в энергетике, новые солнечные батареи и пр.

Какие позиции на рынке ИИ-технологий занимает Россия? Есть ли у нашей страны шансы составить конкуренцию США и Китаю?

Мы очень часто можем встретить выходцев из России в составе различных коллективов разработчиков большинства известных азиатских, американских и европейских компаний — тот же Сергей Брин, разработчик и основатель поисковой системы Google. В этом плане Россия до сих пор выступает как «донор» кадров. Это одновременно и радует, и огорчает, потому что хочется, чтобы наши талантливые ребята развивали технологии на родине. При некотором стечении обстоятельств Яндекс мог бы доминировать над Google.

Что касается успехов внутри страны, то здесь неоднозначная ситуация. Москва сейчас — это второй Сан-Франциско в плане количества, качества и плотности разработок в сфере ИИ. Поэтому многие специалисты не уезжают из Москвы. Есть интересная работа, интересные задачи и развитое экспертное сообщество.

Однако пугает то, что не хватает денег, образования и инфраструктуры для технологического и научного развития в регионах. Все три самых крупных суперкомпьютера находятся в Москве. Наши флагманы — РАН, МГУ, МФТИ — организации с большой научной историей, традициями, большим количеством сотрудников и достаточным финансированием. Есть также и быстрые пионеры, типа Сколтеха, который по многим показателям опережает мировых конкурентов. Мы недавно провели сравнение ведущего британского исследовательского академического центра по ИИ и Сколтеха. Оказалось, что у нас несколько лучше показатели по публикациям и грантам. Это говорит о том, что в России можно и нужно делать науку высокого уровня, но важно преодолеть неравномерное региональное развитие.

У России есть шансы занять достойное место в мире высоких технологий, однако нам нужно придерживаться стратегии «обгонять, не догоняя». Если посмотреть на нашу историю, то, когда мы пытались догнать Запад и Восток, мы проигрывали. Получалось криво, смешно и приводило к различным казусам. Когда мы встряхивались и начинали синтезировать различные подходы, не копируя слепо азиатские или западные, то добивались существенных успехов.

Мы должны трезво оценить то, что происходит на Востоке и на Западе, и то, что нужно нам. У России есть много уникальных задач для себя: управление территорией, развитие ресурсодобывающей промышленности и производства непрерывного цикла. Если нам удастся решить эти задачи, то позже мы сможем масштабировать свои технологические решения на весь мир, и российские технологии будет покупать за большие деньги. Нам нужно становиться на свои рельсы, а не на те, которые проложены по чужим стандартам, и ехать по своему пути, одновременно понимая, что делается вокруг. Не отталкиваясь, не замыкаясь, а синтезируя.

Беседовала программный координатор и редактор сайта РСМД Анастасия Толстухина.